BERT - Bước đột phá mới từ Google

Google đang thực hiện thay đổi lớn nhất đối với hệ thống của mình kể từ khi giới thiệu công cụ RankBrain. Cho đến hiện tại, BERT được xem là bước đột phá vượt bậc trong việc cải thiện thuật toán cho cỗ máy tìm kiếm, giúp người dùng có thể tìm được thông tin có độ phù hợp cao.

Bạn biết gì về mô hình BERT?

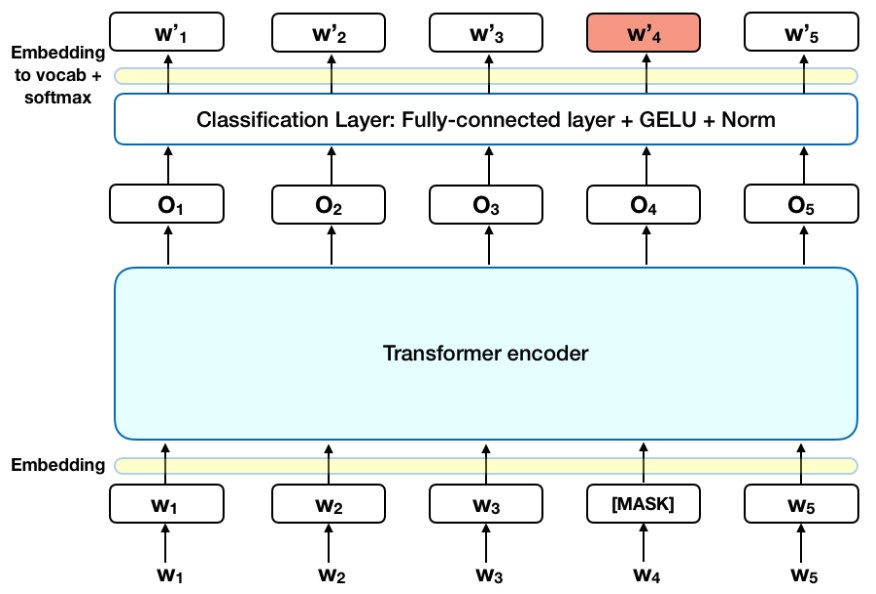

BERT được viết tắt của Bidirectional Encoder Representations from Transformers (đại diện bộ mã hóa 2 chiều), một kiến trúc mới cho lớp bài toán Language Representation được Google công bố vào đầu tháng 11 năm 2018.

Không giống như các mô hình trước đó, BERT được thiết kế để đào tạo ra các vector đại diện cho ngôn ngữ văn bản thông qua ngữ cảnh 2 chiều (trái và phải). Kết quả là, vector đại diện được sinh ra từ mô hình BERT được tính chỉnh với các lớp đầu ra bổ sung đã tạo ra nhiều kiến trúc cải tiến đáng kể cho các nhiệm vụ xử lý ngôn ngữ tự nhiên như Question Answering, Language Inference,…mà không cần thay đổi quá nhiều từ các kiến trúc cũ.

Mô hình BERT – Bước đột phá mới trong công nghệ xử lý ngôn ngữ tự nhiên

Công nghệ này cho phép bất cứ ai đều có thể hiểu rõ hơn về sắc thái và ngữ cảnh của các từ trong tìm kiếm và kết hợp các truy vấn đó với kết quả sao cho phù hợp hơn.

Bước đột phá này là kết quả của nghiên cứu của Google: các mô hình xử lý các từ liên quan đến tất cả các từ khác trong một câu, thay vì từng từ một theo thứ tự. Do đó, các mô hình BERT có thể xem xét toàn bộ ngữ cảnh của một từ bằng cách xem xét các từ xuất hiện trước và sau khi nó đặc biệt hữu ích để hiểu ý định đằng sau các truy vấn tìm kiếm.

Mô hình BERT giúp cải thiện tìm kiếm bằng nhiều ngôn ngữ

Một đặc điểm mạnh mẽ của các hệ thống này là chúng có thể học hỏi từ một ngôn ngữ và áp dụng chúng cho các hệ thống khác. Vì vậy, chúng ta có thể lấy các mô hình từ các cải tiến bằng tiếng Anh và áp dụng chúng cho các ngôn ngữ khác. Điều này giúp nó trả lại kết quả có liên quan tốt hơn bằng nhiều ngôn ngữ khác nhau.

Mô hình BERT giúp tìm kiếm đa dạng ngôn ngữ

Đối với các đoạn trích nổi bật, chúng ta sử dụng mô hình BERT để cải thiện các đoạn trích nổi bật ở 20 quốc gia có tính năng này và thấy những cải tiến đáng kể trong các ngôn ngữ như tiếng Hàn, tiếng Hindi và tiếng Bồ Đào Nha. Hiện tại, BERT đã có sẵn trên Github và hiện mới chỉ hỗ trợ tiếng Anh nhưng mục tiêu của Google sẽ là phát hành các mô hình được đào tạo trên nhiều ngôn ngữ khác nhau trong tương lai.

BERT – Bước đột phá mới từ Google

Sau 1 vài tuần ra mắt, BERT gần như đã chiếm top tất cả các nhiệm vụ của xử lý ngôn ngữ tự nhiên từ trước đến nay như 1 lần nữa khẳng định lại sức mạnh của mình. BERT có thể ảnh hưởng đến khoảng 10 phần trăm của tất cả các tìm kiếm của Google. Đây có thể coi là 1 bước nhảy vượt bậc của Google trong lĩnh vực tìm kiếm. Thực tế là nó có thể tiếp cận và cho phép tinh chỉnh nhanh và có khả năng cho phép một loạt các ứng dụng thực tế trong tương lai.

BERT là bước đột phá mới của Google

Google nói rằng họ đã làm việc để đảm bảo rằng việc thêm BERT vào thuật toán tìm kiếm của mình làm giảm sự sai sót – một vấn đề phổ biến ở các mô hình đào tạo.

Hy vọng sau bài này, chúng ta sẽ có những hiểu biết hơn về mô hình mới và tuyệt vời này của Google. Biết đâu trong một ngày không xa nữa có thể áp dụng được cho các bài toán xử lý ngôn ngữ tự nhiên cho tiếng Việt, hỗ trợ công việc và cuộc sống của bạn!